对于许多动物,视觉是一个占主导的感官。人工智能领域目前关注最多的也是视觉。视网膜的视杆细胞可以检测到1个至10万个光子,而视锥细胞以能辨别颜色著称,还可以感受到运动带来的模糊,用来解码运动的方向、速度等参数[1]。这种使用两种不同的细胞(对应不同机制)去处理视觉的不同层面,值得AI视觉借鉴。

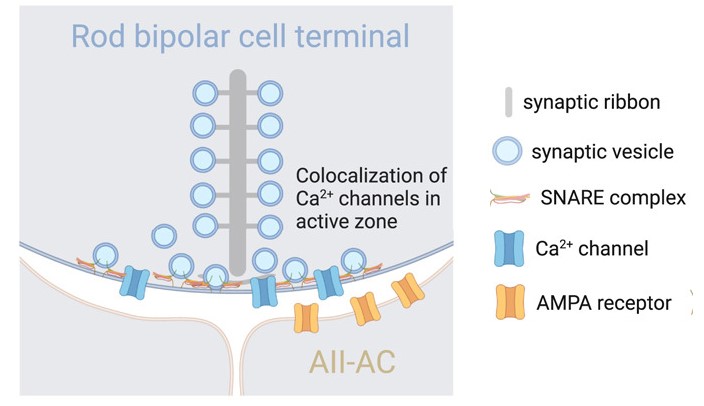

跟内耳和前庭类似,带状突触也在视觉的光信号转变为电信号向下游神经元传递中发挥作用(图11.1)。对小鼠视杆细胞的研究表明,幼鼠开眼后带状突触的囊泡储备更稳定而充足,对于成熟突触,短暂的亮光大约会伴随着4000个囊泡的释放[2],使得视觉的判定更加灵敏 。

图11.1 小鼠视杆细胞的带状突触示意图。感光输入的双极细胞是一类兴奋型中间神经元。A II型Amacrine细胞(AII-AC)是哺乳动物视网膜中最常见的一类Amacrine神经元,既接受来自视杆细胞的兴奋性输入,又与视锥细胞相作用。随着上述两类细胞间带状突触的成熟,可以一次释放数千个囊泡,产生明确的信号。来自[2]。

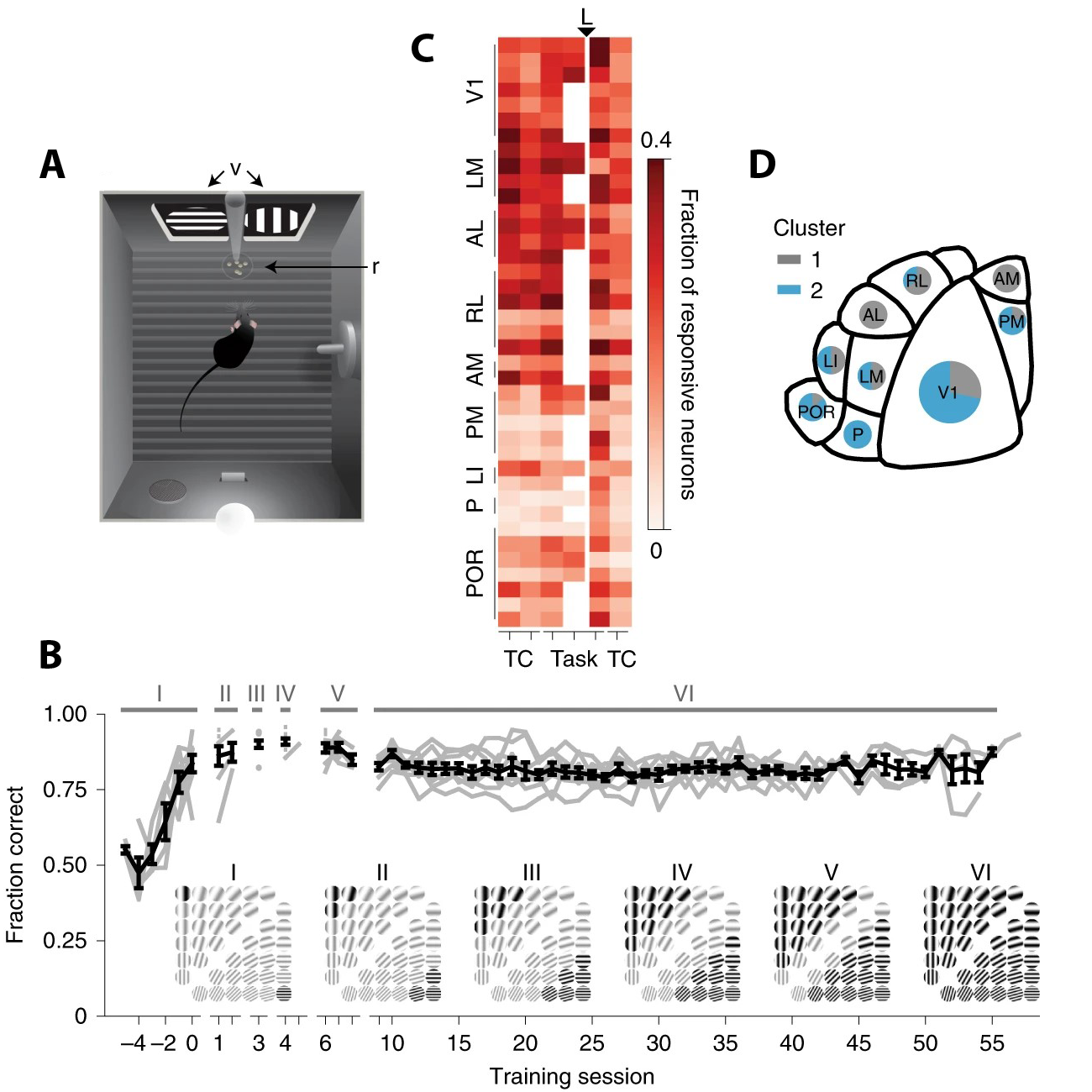

小鼠视觉皮层的不同区域(每个区域包含数百至数千个神经元)对不同特征的敏感性已经存在差异,并且这些区域之间存在相互交流[3-5]。这使得在小鼠能够在最初几次试验中迅速学会对视觉刺激进行分类,并且仅使用一小部分神经元即可完成。这与当下人工视觉使用的数百层,且一个网络识别所有特征的模式不同。

例如,在图11.2描述的实验中[6],小鼠能够只基于个位数个示例,就学会了根据光栅的方向和间隔在成对出现的两组光栅之间作判别(图11.2B,靠近中间两组边界处的光栅图样本来就远不如两端的典型),选对组别后小鼠可获得水作为奖励。图11.2B展示了8只小鼠平均后的学习曲线。小鼠们在正式开始测试前先根据两个最典型的光栅接受了几次训练(x轴-4至0,Stage I,在4-6天内完成),然后几乎立即可以准确应用,可能只是因为不典型图样(Stage V, Stage VI),或者对喝水不感兴趣,而降低了准确率(图11.2B)。和其它感官类似,有食物或水奖励(或者吓鼠的负面刺激)的组别可能对小鼠更重要,也可能略微影响对两组特征的学习。

图11.2 小鼠视觉皮层(V1)识别光栅的学习过程。小鼠在如(A)所示的环境中接受训练和测试。(B)的训练分I-VI共6个阶段,下方展示了从典型图样开始逐渐包括所有不典型图样的过程,黑色的是在该阶段包括的光栅图样。V1,初级视觉皮层;LM,外内侧;LI,外侧中间区;AL,前外侧;RL,喙侧区;AM,前内侧;PM,后内侧;P,后,POR,后内侧。小鼠V1直接输入到其他视觉区域,而已知只有V2、V3、V4和中颞区(灵长类大脑MT)接收大量的V1输入。来自[6]。

视觉相关的新皮层的第I层(L1)主要包含细胞体在更深层的神经元的树突(L2、L3、L5,偶尔也有来自L4的)[7,8]。(遵循大脑自上而下理念被武断命名的、面积最大的)初级视觉皮层(V1)的L1和L4接收来自大脑的输入,而L5-L6输出到进化上更古老的区域,如丘脑。丘脑包含关于运动的信息[9,10](丘脑在清醒时和睡眠时都很重要),可以进一步输出到大脑皮层其他区域。

视觉皮层的自发活动在动物睁开眼睛之前就开始了。视网膜神经节细胞(retinal ganglion cells ) 在发育时过度生长,也是一种先饱和再减的方式。在小鼠出生后还未睁眼时,视觉皮层的自发活动就在指导视网膜神经节细胞组成的网络进行剪枝:与自发活动同步的神经元被保留、长出对应的新分支,而不同步的神经元或分支被清除[11]。(之后在记忆的章节会看到,由新记忆诱导的小鼠新生神经元也采取先饱和生长、再根据刺激使用状况丢失的策略。)

大鼠出生后数天睁开眼睛后,大鼠视觉皮层的L2-L4中具有对相似方向或空间频率偏好的相邻神经元就有了同步放电现象,而较深的L5-L6层神经元还不同步[12](L6输出到屏状核[13],与注意力相关,之后会详述)。与之一致的,成年小鼠视觉皮层在较浅的表层比在更深层表现出更多的连接[14]。

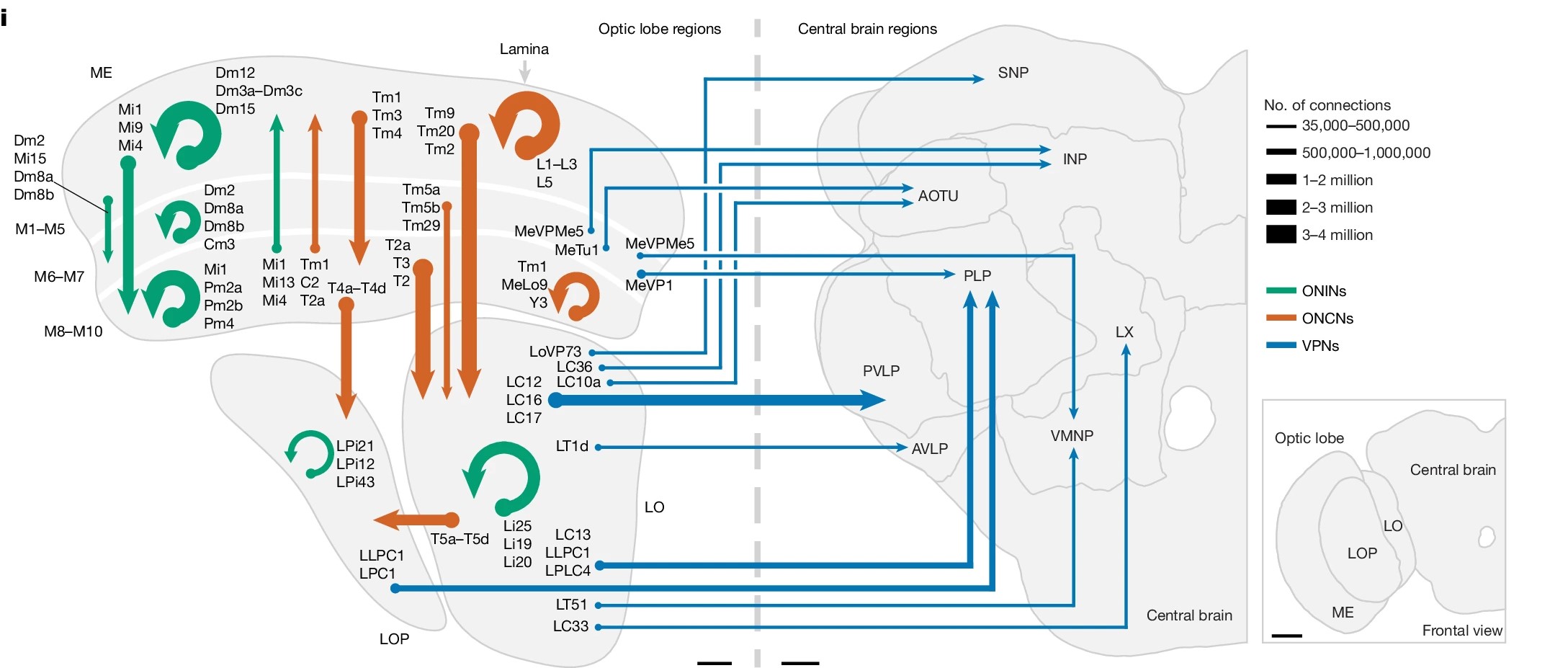

不止小鼠,果蝇的数万个视觉神经元也有明确的分工[15],根据形态与连接定义的数百种不同类型的神经元有各自的跨层分布特征(图11.3),一起构成果蝇复眼对应的几乎一样的重复单元。上述神经元中的一部分(近5万个神经元中的4500个)再分别输出到果蝇大脑的多个脑区(图11.3,蓝色)。我们知道,昆虫复眼在对运动信息的捕捉等方面有一些优势,它们的视觉系统可以完整地被研究了。

图11.3 果蝇视叶各种神经元之间及与中央复合体之间的连接。箭头粗细代表连接数目。ONIN,optic neuropil intrinsic neurons(绿色,neuropil是形态学定义的密集分布区域);ONCN,optic neuropil connecting neurons(橙色,连接两个以上密集分布的neuropil区域);VPN,visual projection neurons,视觉投射神经元(蓝色),投射至中央复合体。反向的VCN(visual centrifugal neurons),即从中央复合体至视叶的神经元,未显示。

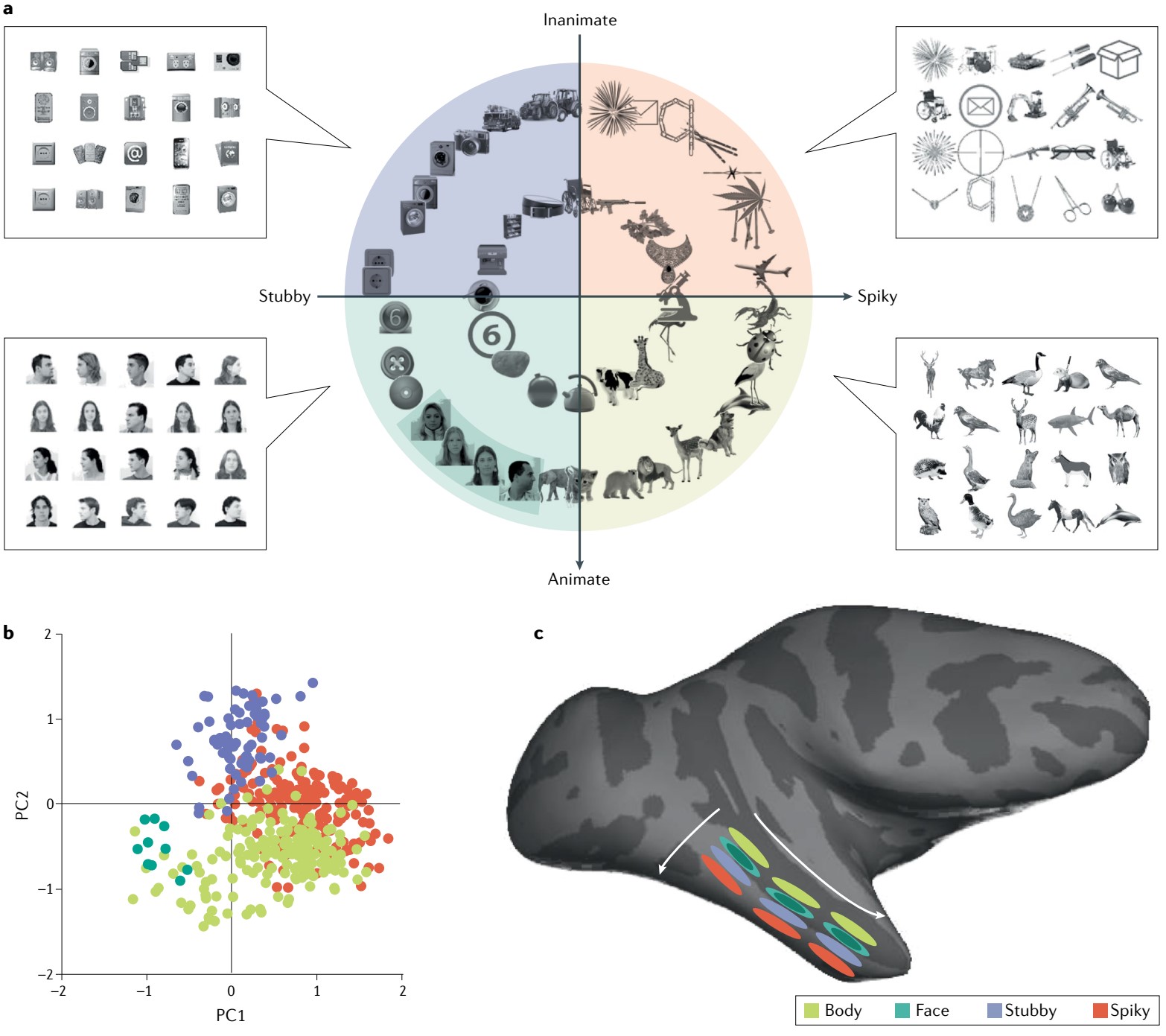

回到哺乳动物,近年研究表明,视觉处理后对物体和面部的表征(大脑颞叶face patch region)主要由两个维度构成四个象限(图11.4a),把物体分为活的和不活的,然后是圆的和尖的(有危险?)[16]。我们更倾向于在物体中看到笑脸,比如汽车的前脸是和善还是凶悍。对人体的胳膊、腿等也会重点关注,并作为尺寸参照。而电影、动图等刚出现时的震撼感受可能也因为它们被归类为活的。

图11.4 对物体特征的一般编码。a)物体空间最主要两个维度的四象限展示。b)将所有记录物体的细胞(482个)投影到主成分1和2上。c)显示了猴子颞下皮层中根据物体空间的四个象限组织的三重重复的地形图。在人类中,梭状回(布罗德曼37区)似乎更多地卷到脑叶的底部。来自[16]。

遗传和后天刺激在视觉发育中都很重要。家养小狗们在它们才睁开眼睛、看到了他们的母亲后没多久就看到人类的脸,并学会了阅读我们的面部表情。在我们看来,长相相似的动物,在动物眼中,可以说是各具特色的。鱼和鸟类可以识别出它们的很多邻居[17]。根据斑点和头部宽度,小龙虾可以识别战斗对手[18]。这些案例说明,不同物种视觉处理的精细度,取决于进化中的需求。

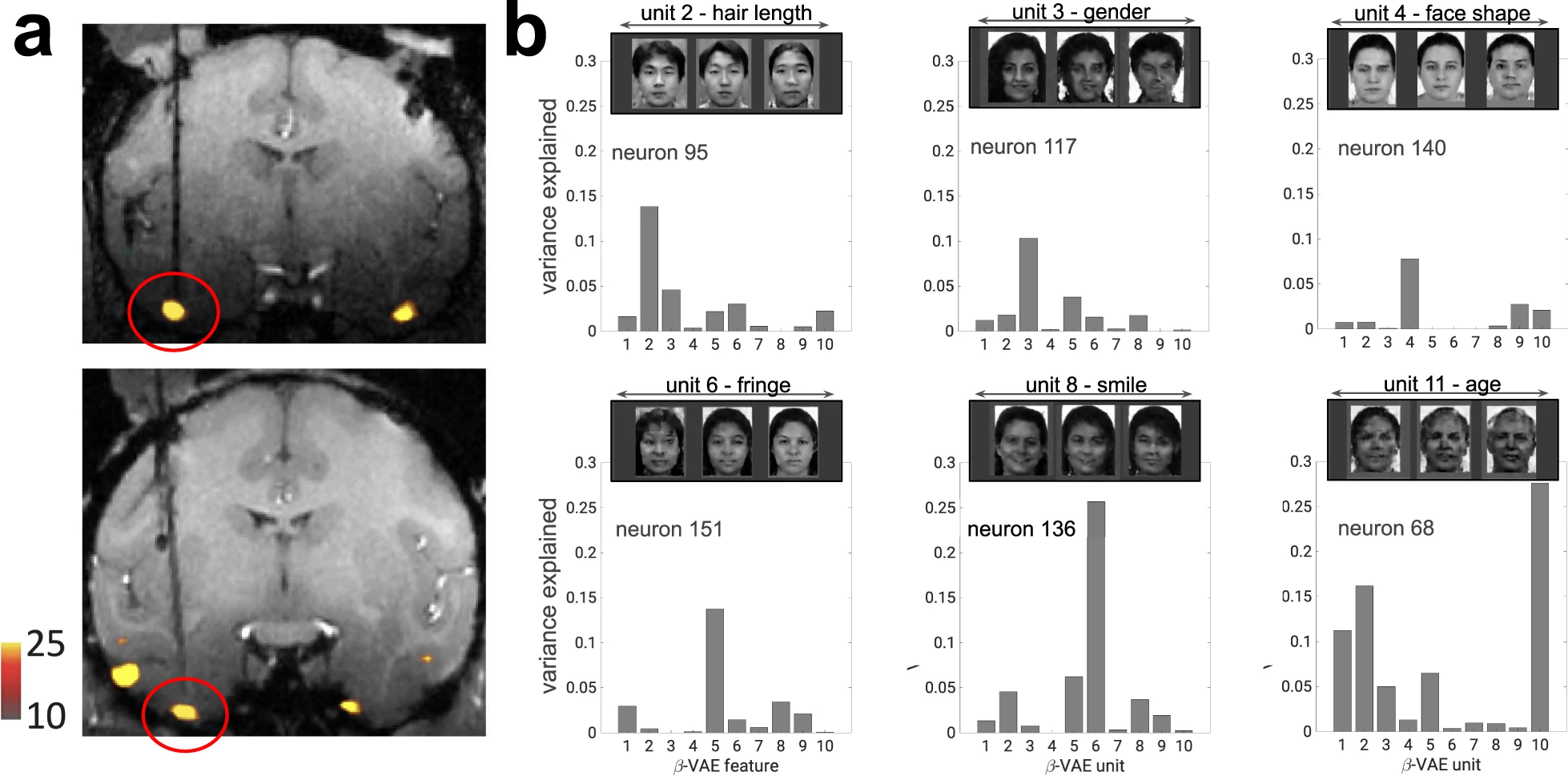

而所有这些认知能力不需要很多神经元就可以实现[19]。基于灵长类200个细胞的胞外电信号记录,就可以线性重构脸部图像。每个编码面部图像的细胞,将传入的面部视觉刺激投射到两维的坐标轴上,这是一个降维从而可以用于大量面部识别的机制[19]。对同一脑区的研究发现可在单个神经元层面解释脸部的各种特征,从年龄、性别到更具体的眼间距、眉毛粗细都会被分解成一个个由单一神经元编码的特征[21]。

图 11.4 单个神经元的反应可以很好地通过单个相互不关联的隐藏单元加以解释。a)显示横切后两种灵长类动物中功能核磁共振识别的面部脑区位置。b)单个神经元解释了对2100个面孔的反应的差异。单个神经元的响应方差主要通过编码不同语义的信息来解释,使用深度无监督生成模型,β-变分自编码器(beta-VAE)解码。来自[16]。

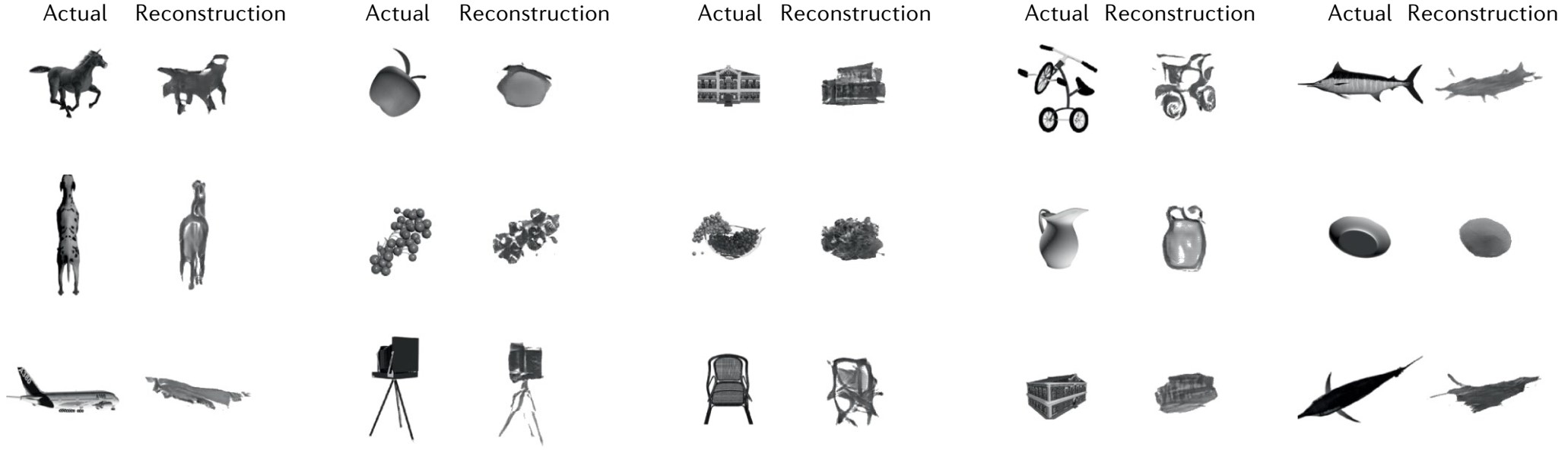

不仅是面部特征,根据灵长类研究记录的数百个神经元的功能核磁信号,可以从一个标准图像数据库(该包含物体标签的数据库以及人工智能比赛即李飞飞的工作)中重建被试猴观看到的图像(图11.5 [20],后文会提到我们的大脑很可能也是一个基于数据库的生成系统,只是可以更好地迭代)。

图11.5 利用图28中4个网络中采样的482个细胞,基于生成对抗网络重建随机对象。作者通过了一组包含18700张无背景物体图像(http://www.freepngs.com)和600张人脸图像(FEI数据库)的图像集,所有图片都没有给被试猴子展示过。将这些图像经由AlexNet模型投影到使用1224张原始刺激集计算的物体空间。对每幅图像,将从神经活动重建的目标特征向量,并与来自新图像集中的图像目标特征向量进行比较。将新图像集中与重建目标特征向量距离最小的图像作为该目标特征向量的“重建”。来自[21]。

因此,如果一个人的照片上有划痕,我们的大脑可能会用单独的细胞分别检测和表征划痕和面部,而不像数据科学家开发的统计平均方法。这同样源于视觉对底层特征的独立感知。

传统上认为视觉信息处理是分层、分阶段进行的: 早期阶段处理视觉领域的低级特征(如边缘,轮廓,颜色和形状) ,而复杂的表征,如整个物体和面部,只出现在后续的颞下皮层[22]。这在人工智能领域已经是盛行了几十年的理念。然而事实上,视觉皮层中的单个神经元已经编码了图像的不同特征,比如面部的年龄、微笑、头发厚度(图11.4)。人工智能领域对特征的分层级处理,是没有理解大脑皮层各细胞分工协作、各有所长的逻辑。期待今后也会有不需要那么多神经元的高效算法以及硬件阵列。

参考文献:

[1] Silverstein, Steven M, and Richard Rosen. (2015). “Schizophrenia and the Eye.” Schizophrenia Research. Cognition 2 (2): 46–55.

[2] Kim, M.-H., Strazza, P., Puthussery, T., Gross, O. P., Taylor, W. R., & von Gersdorff, H. (2023). Functional maturation of the rod bipolar to AII-amacrine cell ribbon synapse in the mouse retina. Cell Reports, 42(11), 113440. https://doi.org/10.1016/j.celrep.2023.113440

[3] Marshel, James H., Marina E. Garrett, Ian Nauhaus, and Edward M. Callaway. (2011). “Functional Specialization of Seven Mouse Visual Cortical Areas.” Neuron 72 (6): 1040–1054.

[4] Bennett, Corbett, Samuel D Gale, Marina E Garrett, Melissa L Newton, Edward M Callaway, Gabe J Murphy, and Shawn R Olsen. (2019). “Higher-Order Thalamic Circuits Channel Parallel Streams of Visual Information in Mice.” Neuron 102 (2): 477-492.e5.

[5] D’Souza, Rinaldo D., Quanxin Wang, Weiqing Ji, Andrew M. Meier, Henry Kennedy, Kenneth Knoblauch, and Andreas Burkhalter. (2022). “Hierarchical and Nonhierarchical Features of the Mouse Visual Cortical Network.” Nature Communications 13 (1): 503. https://doi.org/10.1038/s41467-022-28035-y.

[6] Goltstein, Pieter M., Sandra Reinert, Tobias Bonhoeffer, and Mark Hübener. (2021). “Mouse Visual Cortex Areas Represent Perceptual and Semantic Features of Learned Visual Categories.” Nature Neuroscience 24 (10): 1441–51.

[7] Doron, Guy, Jiyun N. Shin, Naoya Takahashi, Moritz Drüke, Christina Bocklisch, Salina Skenderi, Lisa de Mont, et al. (2020). “Perirhinal Input to Neocortical Layer 1 Controls Learning.” Science (New York, N.Y.) 370 (6523): eaaz3136.

[8] Peng, Hanchuan, Peng Xie, Lijuan Liu, Xiuli Kuang, Yimin Wang, Lei Qu, Hui Gong, et al. (2021). “Morphological Diversity of Single Neurons in Molecularly Defined Cell Types.” Nature 598 (7879): 174–81.

[9] Roth, Morgane M, Johannes C Dahmen, Dylan R Muir, Fabia Imhof, Francisco J Martini, and Sonja B Hofer. (2016). “Thalamic Nuclei Convey Diverse Contextual Information to Layer 1 of Visual Cortex.” Nature Neuroscience 19 (2): 299–307.

[10] Bennett, Corbett, Samuel D Gale, Marina E Garrett, Melissa L Newton, Edward M Callaway, Gabe J Murphy, and Shawn R Olsen. (2019). “Higher-Order Thalamic Circuits Channel Parallel Streams of Visual Information in Mice.” Neuron 102 (2): 477-492.e5.

[11] Matsumoto, N., Barson, D., Liang, L., & Crair, M. C. (2024). Hebbian instruction of axonal connectivity by endogenous correlated spontaneous activity. Science, 385(6710). https://doi.org/10.1126/science.adh7814

[12] AW, Ishikawa, Komatsu Y, and Yoshimura Y. (2018). “Experience-Dependent Development of Feature-Selective Synchronization in the Primary Visual Cortex.” The Journal of Neuroscience : The Official Journal of the Society for Neuroscience 38 (36): 7852–69.

[13] Goll, Yael, Gal Atlan, and Ami Citri. (2015). “Attention: The Claustrum.” Trends in Neurosciences 38 (8): 486–95.

[14] Campagnola, Luke, Stephanie C. Seeman, Thomas Chartrand, Lisa Kim, Alex Hoggarth, Clare Gamlin, Shinya Ito, et al. (2022). “Local Connectivity and Synaptic Dynamics in Mouse and Human Neocortex.” Science 375 (6585). https://doi.org/10.1126/science.abj5861.

[15] Nern, A., Loesche, F., Takemura, S., Burnett, L. E., Dreher, M., Eyal Gruntman, Hoeller, J., Huang, G. B., Januszewski, M., Klapoetke, N. C., Koskela, S., Longden, K. D., Lu, Z., Preibisch, S., Qiu, W., Rogers, E. M., Pavithraa Seenivasan, Zhao, A., Bogovic, J., & Canino, B. S. (2025). Connectome-driven neural inventory of a complete visual system. Nature. https://doi.org/10.1038/s41586-025-08746-0

[16] Arcaro, Michael J., and Margaret S. Livingstone. (2021). “On the Relationship between Maps and Domains in Inferotemporal Cortex.” Nature Reviews Neuroscience 22 (9): 573–583.

[17] Balcombe, Jonathan. (2017). What a Fish Knows: The Inner Lives of Our Underwater Cousins. Scientific American.

[18] Velden, Joanne Van der, Ying Zheng, Blair W Patullo, and David L Macmillan. (2008). “Crayfish Recognize the Faces of Fight Opponents.” PloS One 3 (2): e1695.

[19] Chang, L., & Tsao, D. Y. (2017). The Code for Facial Identity in the Primate Brain. Cell, 169(6), 1013-1028.e14.

[20] Bao, Pinglei, Liang She, Mason McGill, and Doris Y Tsao. (2020). “A Map of Object Space in Primate Inferotemporal Cortex.” Nature 583 (7814): 103–108.

[21] Higgins, Irina, Le Chang, Victoria Langston, Demis Hassabis, Christopher Summerfield, Doris Tsao, and Matthew Botvinick. (2021). “Unsupervised Deep Learning Identifies Semantic Disentanglement in Single Inferotemporal Face Patch Neurons.” Nature Communications 12 (1): 6456.

[22] Yamins, D. L. K., & DiCarlo, J. J. (2016). Using goal-driven deep learning models to understand sensory cortex. Nature Neuroscience, 19(3), 356–365.

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号